Ataque con cuchillos a niñes ingleses, desata violentos disturbios de racistas

Por Adán Salgado Andrade

Desde que se creó el ChatGPT y todos sus sucedáneos de la llamada Inteligencia Artificial, IA, han sido más las cosas malas en que se han aplicado, que las buenas. Además, mucho tiene que ver el perfil de sus creadores, quienes han pensado más en blancos, al diseñarlas, que en el resto de las razas. Desde el inicio, esos sistemas están prejuiciados y son hasta discriminadores, pues la IA continúa alimentándose con materiales racistas y sexistas, que luego se distribuyen alrededor del mundo (ver: https://adansalgadoandrade.blogspot.com/2023/05/la-mal-llamada-inteligencia-artificial.html).

Incluso, los pueden hackear y obligarlos a emitir mensajes de odio o racistas, usando el llamado prompt-injection, una vulnerabilidad que afecta a algunos modelos de IA, como han demostrado varios expertos en ciberseguridad (ver: https://www.wired.com/story/chatgpt-prompt-injection-attack-security/).

Un ejemplo es la desinformación, cada vez más abundante. Y ésa, se da en múltiples formas. Por ejemplo, se pueden manipular imágenes de personalidades hablando con lenguaje inadecuado o malas palabras o se manipulan eventos, dando falsas noticias, las que se distribuyen rápidamente por redes sociales como YouTube, Instagram, TikTok o Telegram.

Un ejemplo de esa nefasta situación lo expone el artículo de The Guardian, titulado “Cómo bots de TikTok e IA, han reforzado el surgimiento de la violencia de la ultraderecha en Inglaterra”, firmado por Ben Quinn y Dan Milmo, en el que refieren la brutal violencia que se dio cuando extremistas supremacistas ingleses, influenciados por falsas noticias de que el atacante de niñes, un día antes (entró con un cuchillo a una escuela de baile y atacó a niños que bailaban a ritmo de Taylor Swift, matando a tres niñas e hiriendo a diez más y a dos adultos, los maestros), era inmigrante musulmán (en realidad, se llama Axel Rudakubana, de raza negra, nacido en Inglaterra, de padres ruandeses), lo que desató la ira de esos enajenados, muchos, hasta borrachos, quienes atacaron e incendiaron patrullas, vandalizaron una mezquita y otras propiedades e hirieron a varios policías (ver: https://www.theguardian.com/politics/article/2024/aug/02/how-tiktok-bots-and-ai-have-powered-a-resurgence-in-uk-far-right-violence).

Comienzan los reporteros señalando que “menos de tres horas después del ataque con cuchillos, que dejó tres niñas fallecidas, una imagen generada con IA, fue compartida en X, por una cuenta llamada Invasión Europea (Europe Invasion). Mostraba a hombres barbones, en su ropa tradicional musulmana, fuera del Parlamento, uno de ellos, sosteniendo un cuchillo, detrás de un niño llorando que vestía una playera con la insignia de la bandera inglesa. El tweet, que ya ha sido visto 900,000 veces, tenía la frase ‘¡Debemos de proteger a nuestros niños!’ y fue compartido por una de las cuentas más poderosas de desinformación sobre los acuchillamientos de Southport”.

Nada más vean a qué niveles está llegando el racismo en Europa (a pesar de que ha sido de África o Asia, de donde los europeos han obtenido gran parte de los recursos que les permiten vivir cómodamente). Claro que el hecho de que el atacante fuera negro, todavía retroalimenta más el discurso de odio hacia los inmigrantes, pero, como dice el proverbio, por uno, pagan todos los demás. Y con las oleadas de inmigrantes africanos que tratan de llegar a Inglaterra, los problemas se agravarán.

Dicen los reporteros que los desinformadores usan todo tipo de redes para difundir falsas imágenes. Incluso emplean Suno, “una plataforma para generar canciones, como la de Southport Saga, en donde una voz femenina canta letras como ‘vamos a cazarlos a como sea’”.

Y con esas herramientas, “se ha logrado unificar a la fracturada ultraderecha en Inglaterra”. Como señalo antes, para ese tipo de deleznables, violentas acciones, está sirviendo mayoritariamente la IA. Sus aplicaciones en el bienestar, digamos, son las menos.

“Un surgimiento de la actividad de la ultraderecha, no visto en diez años, ha llevado a más de diez protestas por todo el país, promovidas en plataformas tales como X, TikTok o Facebook, luego de los violentos disturbios”. Muy seguramente ahí quedarán y seguirán esas violentas protestas por mucho tiempo. Y hasta puede suceder lo que pasa en Estados Unidos, que ese país está dividido en supremacistas (los que apoyan a Donald Trump – 1946) y progresistas (los que apoyan a la vicepresidenta Kamala Harris – 1964). La presidencia del nefasto, racista Trump, retroalimentó mucho a aquéllos supremacistas (ver: https://adansalgadoandrade.blogspot.com/2020/11/los-racistas-supremacistas.html).

Están alentando los ultraderechistas ingleses a que se asesine al nuevo primer ministro, Keir Starmer (1962), que se ataquen las propiedades gubernamentales y “están fomentando el antisemitismo extremo”. Aquí, debo decir que la masacre judía en Gaza, supongo que está teniendo ese efecto, no sólo entre los supremacistas, sino en todo el mundo (ver: https://adansalgadoandrade.blogspot.com/2024/07/las-destrozadas-vidas-de-los-gazaties.html).

Un importante Centro de Análisis de Contraterrorismo ha advertido que “hay un riesgo de que la ultraderecha pudiera lograr un nivel de movilización no visto desde que la Liga de Defensa Inglesa (EDL, por sus siglas en inglés), estalló en las calles en los años 2010s”.

Es muy probable, pues con ese poder de difusión de la desinformación, de mostrar como verdad falsedades, muy fácilmente pueden miles de enajenados participar en esos violentos disturbios. Actúan como zombis, tal como muestra la exitosa cinta mexicana animada “El Santos contra la Tetona Mendoza”, dirigida por Alejandro Lozano, del 2012, en donde un virus zombi esclaviza a toda la gente, obligándola a realizar cosas inimaginables, como tirarse por un precipicio, sin el más mínimo cuestionamiento (ver: https://es.wikipedia.org/wiki/El_Santos_contra_la_Tetona_Mendoza).

Andrew Rogoyski, director del Instituto de la IA Personalizada, de la Universidad de Surrey, citado por los reporteros, urge a que los modelos de IA “coloquen seguros para que no cualquiera pueda crear lo que se le antoje” Ya hay algunos intentos, en ese sentido, buscando que los modelos de IA no sean manipulables negativamente, aunque todavía son imperfectos (ver: https://www.wired.com/story/center-for-ai-safety-open-source-llm-safeguards/).

Otro investigador, Joe Mulhall, director del grupo Esperanza no Odio (Hope Not Hate), también citado por los reporteros, va en la misma dirección, diciendo que “aunque el material generado con IA apenas iba surgiendo, reflejó la creciente colaboración y coincidencias en línea entre grupos e individuos”.

En efecto, si cualquiera llega a generar imágenes casi perfectas, como en ese caso, de un musulmán amenazando a un niño con un cuchillo, los vaticinios son funestos.

Dicen los reporteros que aunque grupos como Britain First (Inglaterra Primero) o Patriotic Alternative (Alternativa Patriótica) son los más importantes en las movilizaciones y disturbios, “hay muchos individuos que no están afiliados a algún grupo en particular”.

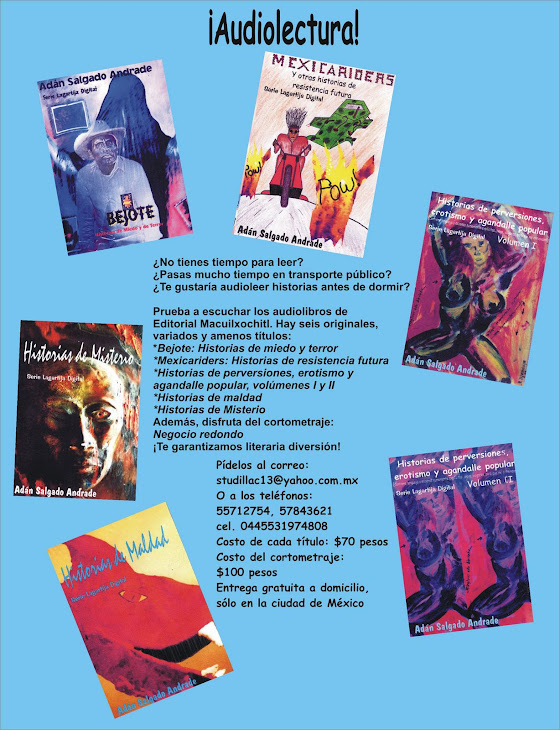

Insisto, si cualquiera puede hacer una imagen de una estereotipada imagen de un musulmán que incluso esté degollando a un niño blanco, es suficiente para incitar el odio y la violencia (un sobrino diseñó con IA a los personajes de una de mis historias, que viene e mi audiolibro Mexicariders, y le quedaron perfectas, como personajes de la vida real. Me dejó asombrado).

Mulhall señala que no hay dirigentes formales, “sino personalidades tomadas de los influencers”.

En efecto, hay muchos individuos en redes como YouTube, que a pesar de que son negativos en lo que dicen y promueven, allí están, como los llamados incel, solteros involuntarios, quienes odian a las mujeres e incitan a que las golpeen o hasta que las maten (ver: https://adansalgadoandrade.blogspot.com/2022/10/los-incel-incrementan-su-machismo-y.html).

Un tipo como el estadounidense-británico Andrew Tate (1986), se autoproclama como “el influencer misógino” y lo lamentable es que tenga millones de vistas y seguidores, pues a la gente le gusta la basura, lo nefasto. “En el 2023, todos sus negocios en línea, le generaban unos $5 millones de dólares mensuales” (ver: https://en.wikipedia.org/wiki/Andrew_Tate).

Así que, como ven, es fácil actualmente triunfar promoviendo contenido negativo y nefasto.

Los reporteros señalan que el inglés Tommy Robinson (1982), activista islamofóbico o el actor, también inglés, Laurence Fox (1978), igualmente un racista que hasta criticó las protestas por la muerte en Estados Unidos del afroestadounidense George Floyd (1973-2020), a manos de un “policía” supremacista, son quienes lideran los disturbios, “así como sitios que difunden teorías conspiracionistas, como Unity News Network (Red Unida de Noticias)”.

En Telegram, otra plataforma “poco moderada”, señalan los reporteros que comentadores “se alegraron con la violencia que se vio en Downing Street, con frases como ‘Espero que lo quemen’ u otro, que decía que ‘Colguemos a Keir Starmer, tratémoslo como musulmán’.

El hashtag #enoughisenough es el preferido de influencers y los agitadores para ponerse en contacto unos con otros. Y los de Patriotic Alternative son los que van en aumento, “incluso, los que comparten opiniones divididas en cuanto a la guerra de Ucrania o la invasión a Gaza, que también han buscado unirse”.

Y el mencionado Robinson, es al que idolatran la mayoría de los extremistas, señalan los reporteros.

Así que vean, la peligrosa combinación de los discursos de odio, retroalimentados con la IA, que está llevando cada vez más y más a una gran división mundial entre ultraderechistas y progresistas, entre conspiracionistas y quienes buscan la verdad, entre racistas y tolerantes (sin contar que con el uso de la IA, se incrementará brutalmente el empleo de electricidad, lo que implicará más contaminación y depredación ambiental. Ver: https://adansalgadoandrade.blogspot.com/2023/02/la-inteligencia-artificial-incrementara.html).

No sólo en la desinformación la IA está influyendo, sino en su creciente empleo para el diseño de armas “inteligentes”, que serán más mortíferas, como tanques o metralletas autónomas (ver: https://adansalgadoandrade.blogspot.com/2022/11/crecen-las-aplicaciones-militares-de-la.html).

Esos son, pues, los “avances tecnológicos” que, se suponía, nos iban a ayudar a mejorar esto que llamamos, eufemísticamente, “civilización”.

Pero no es así, no están dividiendo y destruyendo, aceleradamente.

Contacto: studillac@hotmail.com